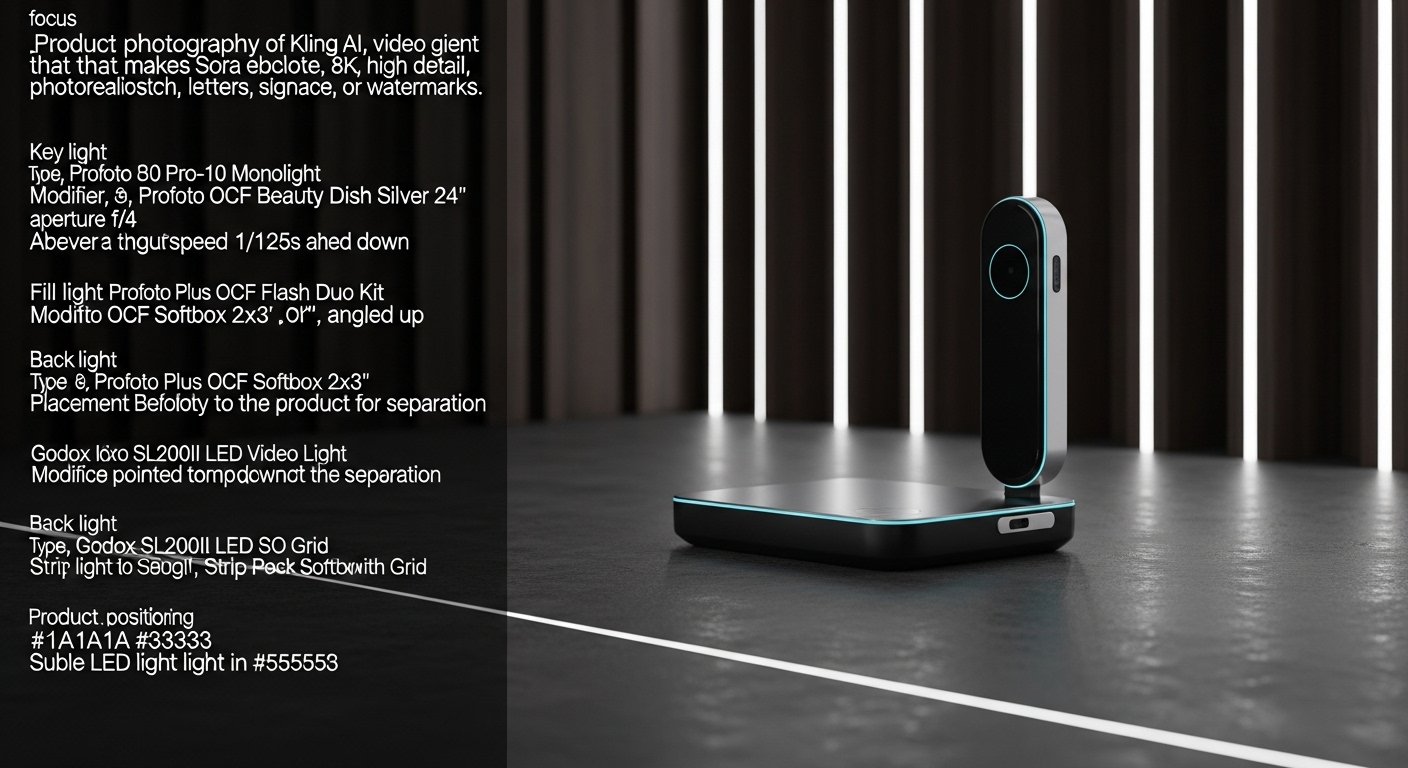

Développé par le géant chinois Kuaishou, Kling AI s’impose aujourd’hui comme la référence incontournable de la génération de vidéo par intelligence artificielle. Accessible gratuitement depuis n’importe quel navigateur, cet outil permet de transformer une simple phrase ou une image fixe en une séquence cinématographique réaliste en quelques minutes seulement.

Tout le monde attendait Sora, le modèle d’OpenAI. C’est finalement Kling qui a pris le marché de vitesse.

Ce générateur ne se contente pas d’animer maladroitement des pixels. Il gère la physique des fluides, les reflets complexes et les expressions faciales avec une cohérence qui manque cruellement à ses concurrents directs comme Runway ou Pika.

Initialement cantonné au web chinois, Kling est désormais ouvert à l’international via une interface web simple. Capable de générer des vidéos en 1080p (et bientôt plus avec la version 1.5), il offre un modèle « freemium » généreux : chaque utilisateur reçoit des crédits quotidiens gratuits, permettant aux créateurs de tester la puissance du moteur sans investissement initial.

Étape 1 : l’accès immédiat

L’outil ne demande aucune installation complexe ni GPU surpuissant.

Il vous suffit de vous rendre sur le site officiel de Kling AI et de vous connecter avec un compte Google. Contrairement à beaucoup d’outils en phase bêta fermée, l’accès est instantané et vous crédite automatiquement de 66 points quotidiens, ce qui équivaut environ à six générations de vidéos standards par jour.

Étape 2 : le « prompting » de réalisateur

Oubliez les descriptions vagues. Kling réagit comme une équipe de tournage.

Dans l’onglet « Text to Video », rédigez votre demande en anglais pour une précision optimale. Ne dites pas juste « un chat qui court ». Écrivez : « Cinematic shot of a fluffy cat running in a neon city, low angle, 4k, highly detailed fur, motion blur ».

L’astuce des pros réside dans la structure du prompt : commencez par le sujet, suivez par l’action, et terminez impérativement par le style visuel (éclairage, type de caméra, ambiance). C’est cette dernière partie qui transforme une vidéo « IA baveuse » en clip exploitable.

Étape 3 : le contrôle du mouvement

C’est la fonctionnalité qui change tout par rapport à Midjourney.

Avant de lancer la génération, ouvrez le menu « Camera Control ». Ici, vous pouvez dicter les mouvements de caméra : un zoom avant lent pour le drame, un travelling latéral pour suivre un sujet, ou une inclinaison pour le dynamisme.

Laissez le curseur de « Creativity Relevance » autour de 0.5 pour un premier essai. Si vous le poussez trop haut, l’IA risque d’halluciner des objets étranges ; trop bas, la vidéo sera statique. Une fois réglé, cliquez sur « Generate » et patientez environ deux minutes.

La vidéo générative quitte le stade du gadget. Avec Kling, elle devient un outil de prévisualisation et de création accessible, redéfinissant dès maintenant la manière dont on conçoit le storyboard et le contenu social.