Mira Murati, l’ex-directrice technique d’OpenAI, a dévoilé mi-mai 2026 une avancée majeure dans les interfaces conversationnelles : les « interaction models », capables d’écouter et de parler simultanément. Son modèle TML-Interaction-Small répond en 0,4 seconde — à la vitesse d’une conversation humaine naturelle.

Une IA qui interrompt, écoute et répond en même temps

Fondée en 2025 par Mira Murati après son départ fracassant d’OpenAI, la startup Thinking Machines Lab vient de présenter sa première avancée technique publique. Et elle s’attaque directement à l’un des talons d’Achille des assistants vocaux actuels : leur incapacité à fonctionner en mode « full-duplex », c’est-à-dire à traiter simultanément l’écoute et la parole.

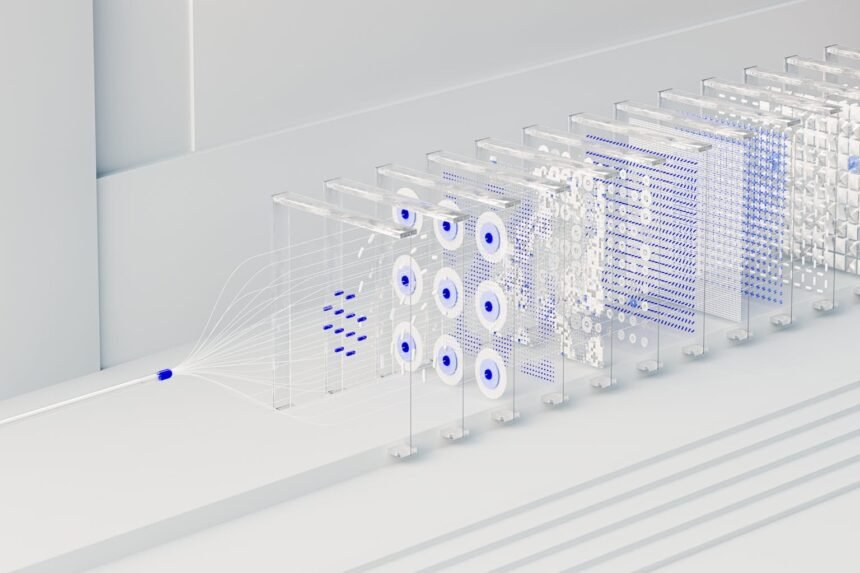

Jusqu’ici, les IA vocales comme GPT Realtime d’OpenAI alternaient entre écoute et réponse, créant une latence perceptible. Thinking Machines propose une architecture radicalement différente : un réseau unique dans lequel la capacité à écouter, parler, voir et marquer une pause est entraînée nativement, et non rajoutée en surcouche.

TML-Interaction-Small : 276 milliards de paramètres

Le modèle dévoilé, baptisé TML-Interaction-Small, repose sur une architecture mixture-of-experts de 276 milliards de paramètres au total, dont 12 milliards seulement sont activés à chaque inférence. Ce choix d’architecture permet de combiner puissance et rapidité d’exécution.

Le résultat est frappant : un temps de réponse de 0,40 seconde, correspondant à la vitesse moyenne d’une réplique humaine dans une conversation naturelle. Sur les benchmarks internes, Thinking Machines annonce des scores un ordre de grandeur supérieurs à ceux de GPT Realtime-2 d’OpenAI — résultat que GPT Realtime-2 avait pourtant présenté comme une révolution il y a quelques mois.

Une architecture en deux couches

La conception de ce système repose sur deux modèles distincts qui fonctionnent en parallèle. Le premier, le modèle d’interaction, reste en permanence « en ligne » avec l’utilisateur. Le second opère en arrière-plan pour gérer le raisonnement complexe et les appels d’outils, sans interrompre le flux conversationnel.

Entre les deux, des micro-tours de 200 millisecondes remplacent la boucle classique requête-réponse. L’IA peut ainsi parler, écouter, réagir à ce qu’elle voit via la caméra et lancer des actions en parallèle, sans attendre que l’utilisateur ait fini de s’exprimer.

Dans ce contexte de course aux agents IA, Anthropic avance elle aussi ses pions face à OpenAI avec une valorisation désormais supérieure aux 950 milliards de dollars. La concurrence entre ces laboratoires n’a jamais été aussi serrée.

Disponibilité : preview puis sortie large en 2026

Thinking Machines ne propose pas encore de version publique. La startup prévoit d’ouvrir un accès en « research preview » à un groupe restreint de testeurs dans les prochains mois, avant un lancement plus large prévu d’ici la fin de l’année.

Cette séquence prudente rappelle la stratégie adoptée par Runway dans la vidéo générative, qui a préféré consolider ses modèles avant d’ouvrir en grand l’accès grand public. À la différence que Thinking Machines joue sur le terrain du temps réel, secteur où chaque milliseconde compte.

Du côté des écosystèmes mobiles, cette évolution des assistants vocaux IA s’inscrit dans une tendance de fond : Google renforce aussi Gemini Intelligence sur Android, tandis qu’Apple prépare sa réponse avec une refonte profonde de Siri.

À retenir

- Thinking Machines Lab dévoile TML-Interaction-Small, une IA vocale full-duplex répondant en 0,4 seconde

- L’architecture 276B paramètres (mixture-of-experts) surpasse GPT Realtime-2 d’OpenAI sur les benchmarks

- Accès en research preview prévu dans quelques mois, sortie large d’ici fin 2026