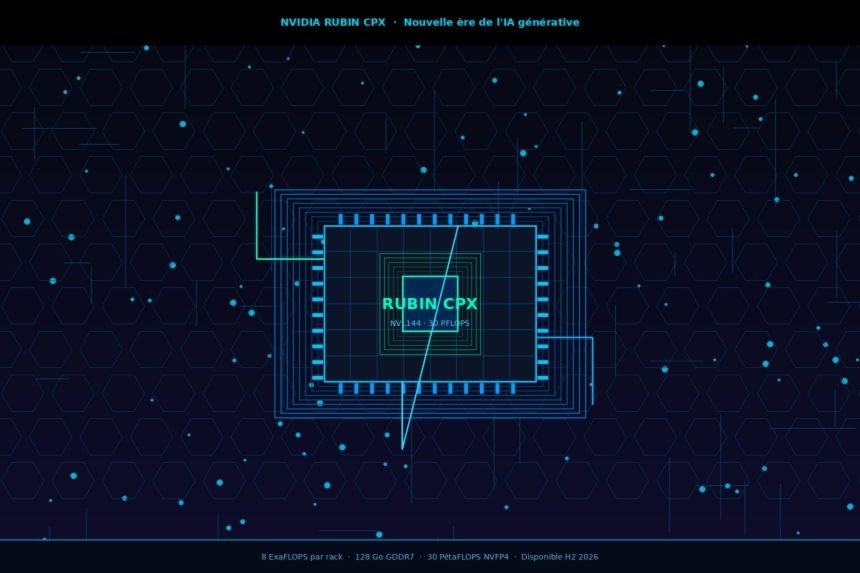

NVIDIA lève le voile sur le Rubin CPX, un processeur graphique conçu pour l’inférence IA sur des contextes de plusieurs millions de tokens. Avec 30 pétaflops de puissance et 128 Go de mémoire GDDR7, ce GPU repousse les limites de l’intelligence artificielle générative.

L’intelligence artificielle n’a jamais été aussi gourmande en puissance de calcul, et NVIDIA entend bien rester l’architecte de l’infrastructure qui la fait tourner. Le géant américain des semi-conducteurs vient d’annoncer le Rubin CPX, une puce pensée pour répondre aux besoins croissants en inférence IA à très grande échelle. Contrairement aux GPU généralistes, le Rubin CPX est taillé pour une mission précise : traiter des contextes de plusieurs millions de tokens — code, vidéo, agents autonomes — avec une efficacité inédite.

Des performances inédites pour l’ère des agents IA

Les chiffres donnent le vertige. Le Rubin CPX affiche 30 pétaflops en précision NVFP4, soutenu par 128 Go de mémoire GDDR7 ultra-rapide. NVIDIA revendique une vitesse de traitement de l’attention trois fois supérieure aux systèmes GB300 NVL72 de génération précédente. En configuration de baies NVL144 CPX, les racks atteignent 8 exaflops de performance IA, 100 téraoctets de mémoire et une bande passante de 1,7 pétaoctets par seconde — soit 7,5 fois les installations précédentes.

Ces performances ouvrent la voie à des usages jusqu’ici hors de portée : assistance au code sur des bases de millions de lignes, génération vidéo longue durée, déploiement d’agents logiciels raisonnant sur de vastes corpus. Les partenaires Cursor, Runway et Magic sont d’ores et déjà en train d’explorer ces possibilités.

Disponible chez les grands clouds dès le second semestre 2026

La commercialisation du Rubin CPX est prévue pour la fin de l’année 2026. AWS, Google Cloud, Microsoft Azure et Oracle Cloud Infrastructure figureront parmi les premiers fournisseurs à déployer des instances basées sur cette architecture, suivis par les spécialistes CoreWeave, Lambda, Nebius et Nscale.

Cette annonce s’inscrit dans la continuité de la plateforme Vera Rubin lancée en début d’année. L’enjeu est stratégique : à mesure que les fenêtres de contexte s’élargissent et les modèles se complexifient, le besoin en infrastructure dédiée explose. NVIDIA ambitionne d’atteindre 1 000 milliards de dollars de revenus à l’horizon 2027 en se positionnant comme l’architecte incontournable de cette révolution.